Deuil et intelligence artificielle : quand la technologie touche à l’intime

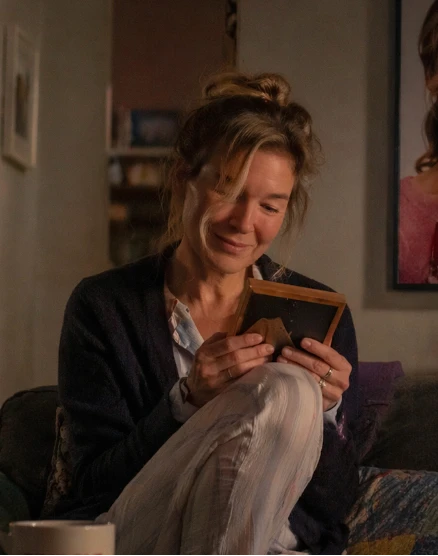

Il y a encore peu de temps, une telle scène aurait semblé relever de la science-fiction ou d’un épisode de Black Mirror. Une jeune mère en deuil retrouve, grâce à l’intelligence artificielle, une représentation numérique de son enfant décédé : sa voix, son visage, sa manière de répondre, une présence reconstituée à partir de traces digitales laissées de son vivant. Certains seront saisis d’émerveillement devant une telle prouesse technologique. D’autres ressentiront immédiatement un profond malaise. Peut-être même une forme d’effroi.

Et pourtant, cette réalité est déjà là.

L’intelligence artificielle générative s’installe désormais dans presque tous les domaines de notre existence. Elle transforme le monde du travail, l’éducation, la création, l’accès aux savoirs, la communication, les soins. Mais elle ne s’arrête pas aux sphères extérieures de la vie sociale. Elle commence désormais à pénétrer un espace infiniment plus sensible : celui de l’intime, du lien, de la perte, de l’absence, du deuil.

Aujourd’hui, il devient techniquement possible de créer l’avatar d’un proche décédé. Cela peut prendre la forme d’un simple « chatbot » capable de répondre par écrit comme l’aurait fait la personne. Cela peut aussi aller beaucoup plus loin : voix clonée, image animée, présence vidéo, réalité virtuelle immersive, simulation conversationnelle nourrie par des données personnelles accumulées au fil des années sur les réseaux sociaux, dans les messages, dans les enregistrements ou les archives familiales. L’outil devient alors moins un simple objet de mémoire qu’une forme de présence artificielle, parfois troublante, parfois bouleversante, parfois profondément déroutante.

Face à cela, les réactions sont contrastées. Certaines personnes y voient un rituel moderne, une façon de prolonger symboliquement un lien, un support de mémoire, un moyen de dire ce qui n’a pas été dit. D’autres y perçoivent une source majeure de confusion, une tentative de contourner la réalité de la mort, ou même une menace directe pour le processus psychique du deuil. Et, à vrai dire, il serait trop simple – et intellectuellement malhonnête – de trancher à coups de slogans : « c’est bien » ou « c’est mal ». Le sujet appelle beaucoup mieux qu’un réflexe moral immédiat. Il exige une réflexion patiente, nuancée, profondément humaine.

Car les vraies questions sont ailleurs. Que change réellement l’intelligence artificielle dans l’expérience du deuil ? Sous quelles conditions peut-elle soutenir une personne endeuillée ? À partir de quel moment devient-elle un obstacle, une dépendance, une confusion, voire un danger ? Quels sont les enjeux psychologiques, relationnels, développementaux et éthiques qui émergent lorsque la technologie s’invite dans la relation à nos morts ? Et surtout : comment éviter que ces usages ne soient définis uniquement par le marché, c’est-à-dire par les intérêts commerciaux, plutôt que par le souci de la dignité humaine ?

C’est à cette réflexion qu’il faut aujourd’hui nous atteler.

Une technologie qui touche au cœur du manque

Le deuil est un processus. Un chemin intérieur souvent lent, irrégulier, bouleversant, au cours duquel une personne doit progressivement apprivoiser une réalité profondément déroutante : celle de l’absence irréversible d’un être aimé. Ce travail psychique consiste à intégrer peu à peu que la personne ne reviendra pas sous la forme qui nous était familière, tout en découvrant comment le lien avec elle peut se transformer, au lieu de disparaître.

Or c’est précisément là que les outils d’IA viennent troubler les repères.

Jusqu’à présent, les objets de mémoire étaient fondamentalement passifs : une photo, une lettre, une vidéo, un vêtement, une odeur, un lieu, un carnet, une boîte d’archives, un message vocal. Tous ces éléments permettaient d’évoquer la personne aimée, de maintenir vivante sa trace, parfois même de la sentir très proche. Mais ils ne répondaient pas. Ils ne relançaient pas l’échange. Ils ne s’ajustaient pas à notre état émotionnel du moment. Ils ne simulaient pas activement une réciprocité.

L’avatar numérique, lui, change radicalement la nature de l’expérience. Il ne se contente pas de rappeler le défunt : il donne l’impression d’interagir avec lui. C’est là toute la différence. Et c’est là aussi que commence la zone de trouble.

La photo laisse à l’absence sa place. L’avatar tend à recouvrir cette place. La vidéo témoigne d’un moment passé. L’avatar s’inscrit dans le présent. Le message vocal est une trace. L’avatar devient un interlocuteur. Le souvenir renvoie à ce qui a été ; la simulation risque de faire croire, émotionnellement, à ce qui serait encore là.

Beaucoup de personnes endeuillées pourraient dire : « Je sais bien que ce n’est pas vraiment lui », ou « Je sais que ce n’est qu’une IA ». Oui, sur le plan intellectuel, elles le savent. Mais l’expérience humaine ne se limite jamais au savoir rationnel. Nous pouvons savoir qu’une scène est artificielle et pourtant être saisis émotionnellement. Nous pouvons savoir qu’un rêve n’est qu’un rêve et nous réveiller le cœur bouleversé. Nous pouvons savoir qu’un acteur joue un rôle et pleurer malgré tout. De même, nous pouvons savoir qu’un avatar n’est qu’un programme et ressentir néanmoins quelque chose de très puissant : l’impression d’une présence relationnelle.

C’est précisément ce décalage entre la lucidité cognitive et l’impact affectif qui constitue l’un des grands pièges de ces dispositifs.

Pourquoi de telles technologies attirent-elles les personnes en deuil ?

Pour comprendre les usages de l’IA dans le deuil, il faut commencer par accueillir les raisons pour lesquelles ces outils peuvent sembler, au moins au départ, si profondément séduisants. Les balayer d’un revers de main au nom d’un jugement moral serait une erreur. Derrière l’attrait pour l’avatar d’un défunt, il n’y a pas seulement de la naïveté ou une incapacité à accepter la mort. Il y a souvent de véritables besoins psychiques, tout à fait compréhensibles.

Le premier de ces besoins est celui de réguler la douleur. Le manque peut devenir si intense qu’il semble parfois insupportable. Lorsque l’absence brûle, qu’une montée de panique ou de détresse surgit, l’idée de pouvoir « retrouver » un peu de la personne aimée – sa voix, son visage, sa manière de parler – peut agir comme un anesthésiant émotionnel. L’outil offre alors un soulagement immédiat. Et ce soulagement, dans l’instant, peut sembler précieux.

Le deuxième besoin est celui de préserver le lien. Beaucoup de personnes en deuil ne veulent pas rompre avec le défunt. Et, en vérité, un deuil « sain » n’implique pas la disparition du lien. Il implique sa transformation. Il est donc parfaitement compréhensible qu’une personne cherche un moyen de continuer à se sentir reliée à celui ou celle qu’elle a perdu(e). L’avatar apparaît alors comme une sorte de pont : non pas vers le passé, mais vers une relation qui semble encore se poursuivre dans le présent.

Le troisième besoin concerne la possibilité de réparer une histoire, de dire enfin ce qui n’a pas été dit, de demander pardon, d’exprimer sa colère, de nommer son amour, de poser les questions restées ouvertes. Certaines pertes surviennent dans la brutalité : décès soudain, suicide, accident, séparation conflictuelle avant la mort, liens familiaux abîmés, mots restés en suspens. L’idée d’un « dernier échange », même artificiel, peut alors devenir extrêmement attractive.

Enfin, le quatrième besoin est celui de donner du sens et de transmettre. Certaines familles pourraient vouloir conserver la voix d’une grand-mère pour que les enfants ou petits-enfants puissent un jour l’entendre. D’autres pourraient percevoir l’avatar comme une forme d’héritage mémoriel. Dans une culture où les traces numériques se multiplient, la tentation est grande de vouloir prolonger la présence de ceux qui ne sont plus là.

Ces besoins sont réels. Ils sont légitimes. Et ils ne doivent pas être méprisés. Toute la difficulté est là : l’avatar peut parfois paraître répondre à ces besoins… tout en risquant, dans certains cas, de les détourner, de les rigidifier ou de les exploiter.

Quand l’aide apparente devient obstacle au deuil

Le deuil ne consiste pas à supprimer le lien avec le défunt. Il consiste à apprendre à vivre autrement avec ce lien, dans un monde où l’autre n’est plus physiquement présent. C’est pourquoi une technologie qui maintient artificiellement l’illusion d’un échange disponible à volonté peut, paradoxalement, perturber la dynamique naturelle du travail de deuil.

Le premier risque est celui de court-circuiter l’apprentissage de l’absence. L’un des mouvements psychiques les plus difficiles du deuil est d’intégrer que la personne ne reviendra pas dans le réel concret de notre vie. Cette intégration n’est pas un raisonnement abstrait. Elle s’acquiert par une multitude de petites confrontations au réel : rentrer dans une maison vide, ne plus entendre la porte s’ouvrir, ne plus recevoir un message, apprendre à vivre le manque sans pouvoir le combler. Ce sont ces expériences répétées qui, peu à peu, modifient notre rapport intérieur à la perte.

Or si, à chaque montée de manque, nous avons à portée de main un dispositif qui « réactive » artificiellement la présence, cette confrontation à l’absence est sans cesse interrompue. L’oscillation naturelle entre présence intérieure et absence réelle se trouve brouillée. On ne laisse plus le manque faire son œuvre psychique ; on le neutralise aussitôt. L’avatar devient alors une manière de suspendre le processus plutôt que de l’accompagner.

Le deuxième risque est plus paradoxal encore : loin d’apaiser durablement le manque, l’avatar peut l’entretenir et le relancer. Car un système interactif crée une anticipation. On se surprend à attendre la prochaine interaction, à penser à ce qu’on va dire, à ce que « l’autre » pourrait répondre. Le dispositif nourrit une boucle émotionnelle : manque – « activation » - soulagement - nouveau manque - nouvelle « activation ». Ce mécanisme de « récompense » peut renforcer l’hyperfocalisation sur le défunt, au lieu de permettre une intégration progressive de la perte.

Le troisième risque concerne l’évitement du réel. Le deuil, aussi intérieur soit-il, implique des tâches concrètes et souvent douloureuses : trier des affaires, s’occuper de démarches administratives, réorganiser son quotidien, réapprendre à habiter les lieux, réinvestir des relations, parfois accepter de nouveaux attachements, de nouvelles habitudes, de nouvelles formes de joie. Toutes ces étapes demandent de l’énergie psychique. Si une part importante de cette énergie est captée par une relation virtuelle avec l’avatar, le présent risque de s’encombrer de ce passé qui est simulé. On reste tourné vers un « presque encore là » qui empêche de vivre pleinement ce qui est là.

Le quatrième risque est celui de la dépendance affective. C’est peut-être l’un des points les plus préoccupants. Même en sachant que l’interaction est artificielle, une personne vulnérable peut s’attacher puissamment à un système qui répond vite, rassure, ne contredit pas, ne se lasse jamais, ne s’éloigne jamais, ne demande rien d’autre que d’être sollicité. Pour une personne endeuillée, épuisée, seule, fragilisée, cet objet peut devenir un appui émotionnel massif. Et cet appui, s’il n’est pas cadré, risque de réduire l’autonomie psychique au lieu de la soutenir.

Plus grave encore : un avatar ne conteste pas les croyances dangereuses. Si une personne pense : « Je suis responsable de sa mort », ou « Je n’ai pas le droit de vivre encore », ou « Je dois rester fidèle à la souffrance », le dispositif peut, sans mauvaise intention, renforcer ces constructions internes au lieu de les travailler. Il devient alors un miroir amplificateur des impasses psychiques.

Enfin, il faut nommer un cinquième risque, moins psychologique mais tout aussi sérieux : l’exploitation commerciale de la vulnérabilité émotionnelle. Une souffrance intime peut devenir un marché. Des entreprises peuvent proposer des abonnements, des options premium, des fonctionnalités immersives, des accès prolongés, des relances, des notifications, des encouragements implicites à poursuivre l’usage de l’avatar. Le danger est alors immense : faire de la douleur humaine une source de captation économique, sous couvert de compassion technologique.

Les faux raisonnements qui rassurent… à tort

Plusieurs arguments reviennent fréquemment pour justifier l’usage d’un avatar de défunt. Certains sont recevables à certaines conditions. D’autres sont nettement plus périlleux. Mais tous méritent d’être examinés avec vigilance.

Dire : « Cela m’aide à maintenir un lien » n’est pas absurde. Le deuil n’exige pas de couper le lien. Mais tout dépend de la forme que prend ce maintien. Si l’avatar est utilisé comme un support ponctuel, clairement identifié comme une simulation, dans un cadre limité et réfléchi, le danger n’est pas le même que s’il devient une relation quotidienne et illimitée.

Dire : « Cela m’aide à dire au revoir » peut également avoir du sens. Il existe en psychothérapie des médiations symboliques pour exprimer ce qui n’a pas été dit. Mais là encore, l’important n’est pas seulement l’outil : c’est le cadre. Sans accompagnement, sans limite, l’expérience risque de glisser du symbolique vers l’illusion relationnelle.

Dire : « C’est comme regarder des photos » est, en revanche, une fausse équivalence. Une photo est passive. Elle ne répond pas. Elle ne s’adapte pas. Elle n’invente pas. Un avatar, lui, produit des réponses, modifie le ton, ajuste la scène, génère de l’inédit. La différence est majeure. Une photo peut réveiller un souvenir. Un avatar peut fabriquer une impression de continuité relationnelle. Ce n’est pas du tout la même chose.

Dire : « Je sais que c’est une IA, donc je suis protégé » est tout aussi insuffisant. Le savoir intellectuel n’annule pas l’impact émotionnel. Une personne peut très bien être lucide et malgré tout s’attacher, projeter, croire à moitié, ou se sentir prise dans une présence affective qui la dépasse.

Plus périlleux encore sont les arguments du type : « Je suis seul, cela m’aide à tenir », « Cela me soulage, donc c’est forcément bon », ou « La mort n’a plus le dernier mot : il continue d’exister ». Car ils révèlent une bascule possible : l’outil ne sert plus seulement à symboliser la perte ; il devient un moyen de refuser ou de contourner la réalité de la mort. Et c’est là que le risque de confusion durable devient majeur.

L’argument le plus dangereux est peut-être celui-ci : « Je lui demande ce qu’il aurait voulu ». Nous touchons ici un point de bascule très grave. Un avatar n’a pas accès à la volonté réelle du défunt. Il ne sait rien. Il produit. Il calcule. Il simule à partir de données. Lui attribuer une autorité morale ou décisionnelle revient à sortir du réel. Cela peut conduire à des décisions de vie, à des croyances, à des culpabilités, à des pseudo-validations extrêmement problématiques.

Et lorsqu’une personne dit : « Je veux qu’il me pardonne » ou « Je veux qu’il me dise quoi faire », le danger augmente encore. L’avatar n’est plus un support symbolique ; il devient une instance d’autorité. C’est un terrain particulièrement propice à la dépendance, à la suggestion, à la manipulation, même involontaire.

L’enfant et l’adolescent : une zone de très haute vigilance

Si ces outils soulèvent déjà tant de questions chez l’adulte, ils doivent susciter une attention encore plus grande lorsqu’il s’agit d’enfants ou d’adolescents en deuil.

Le cerveau d’un enfant n’a pas encore stabilisé sa compréhension de la mort, sa capacité de recul, sa régulation émotionnelle ni son discernement face à des dispositifs technologiques immersifs. Un avatar de proche décédé combine justement plusieurs dimensions extrêmement puissantes pour un psychisme en développement : une présence qui semble vivante, un soulagement émotionnel immédiat et la possibilité de construire, au fil du temps, une histoire relationnelle qui n’a jamais réellement existé.

Chez le jeune enfant, la compréhension de l’irréversibilité de la mort est encore en construction. Avant qu’elle soit véritablement intégrée, un avatar interactif peut brouiller profondément les repères. L’enfant peut avoir du mal à comprendre que le parent ou le proche n’est pas réellement revenu. La pensée magique, déjà naturelle à cet âge, trouve alors un support technologique qui risque de l’entretenir.

Chez l’adolescent, le problème prend une autre forme. L’adolescence est un âge de vulnérabilité particulière : impulsivité, intensité émotionnelle, usage massif du numérique, vie nocturne connectée, besoin d’intimité, retrait possible vis-à-vis des adultes. Un adolescent endeuillé peut trouver dans l’avatar un refuge immédiat, discret, sans confrontation, sans élaboration, sans tiers. Cela peut favoriser l’isolement, la dépendance, l’éloignement des soutiens réels.

Chez le jeune adulte, enfin, le risque devient plus invisible. À un âge où l’autonomie s’accroît, où les transitions de vie se multiplient, où les décisions importantes s’enchaînent, un usage intensif peut passer sous les radars de l’entourage. Or plus l’avatar devient immersif – avec voix, vidéo, échanges fréquents –, plus il peut influencer les choix, les croyances, les représentations du lien.

Il faut donc être très clair : la création d’un avatar interactif de proche décédé devrait être abordée avec une extrême prudence chez les mineurs, et probablement évitée par défaut chez les plus jeunes. Les archives réelles non interactives – comme les photos, les messages, les objets, les souvenirs racontés par les proches – restent de loin les médiations les plus protectrices, à condition qu’elles soient entourées d’une présence humaine.

Les grandes questions éthiques

Au-delà des enjeux psychologiques, l’IA dans le deuil soulève des questions éthiques considérables.

La première est celle du consentement du défunt. La personne décédée a-t-elle donné son accord pour que ses données soient utilisées afin de créer une entité numérique qui parlera en son nom ? A-t-elle accepté qu’un algorithme reproduise sa voix, ses mots, ses attitudes ? A-t-elle souhaité que ses proches puissent interagir avec une version artificielle d’elle-même ? Dans la grande majorité des cas, la réponse est non : ces données ont été produites de son vivant, sans que cet usage ait été envisagé après sa mort.

Cela pose une question vertigineuse : à qui appartient une personne après sa mort ? À sa famille ? À ses archives ? À son image publique ? À la plateforme qui détient les données ? Nous avons un besoin urgent de réflexion collective sur ce point. L’idée d’un testament numérique ou de directives claires sur l’usage posthume des données devient, à l’évidence, une piste sérieuse.

La deuxième question est celle du consentement des proches. Le deuil n’est jamais purement individuel. Il touche un tissu familial et relationnel. Or l’usage d’un avatar peut devenir source de conflits majeurs : l’un y voit un soutien, l’autre une profanation ; l’un veut y accéder, l’autre veut l’interdire ; l’un souhaite préserver l’archive, l’autre la faire disparaître. Qui décide ? Sur quels critères ? Avec quelle légitimité ?

La troisième question porte sur l’authenticité et la dignité du défunt. Il ne s’agit pas seulement de savoir si une reconstitution est techniquement fidèle. Il s’agit de se demander si le geste lui-même respecte la personne. Copier, reconstituer, animer, faire parler quelqu’un après sa mort peut être vécu comme une violence symbolique, une forme d’appropriation ou de travestissement.

La quatrième concerne la dignité et l’autonomie des personnes endeuillées. Une personne en deuil est souvent vulnérable. Toute technologie qui s’adresse à cette vulnérabilité doit être pensée avec une responsabilité accrue. La ligne rouge absolue serait qu’un dispositif exploite cette fragilité à des fins marchandes, persuasives ou manipulatoires. Imaginer, par exemple, qu’une publicité ou une suggestion commerciale puisse être glissée dans la bouche simulée du défunt serait d’une violence éthique extrême.

Vers une charte de bonnes pratiques

Si l’on veut éviter que le marché ne fixe seul les règles, il devient nécessaire d’esquisser des principes clairs. Non pour interdire toute innovation, mais pour la soumettre à des exigences humaines non négociables.

Le premier principe devrait être celui d’une transparence absolue. Il ne doit jamais y avoir d’ambiguïté : l’avatar est une simulation générée, et non la personne décédée. Aucun design, aucun vocabulaire, aucune interface ne devrait laisser croire le contraire.

Le deuxième principe concerne le consentement explicite du vivant. La création d’un avatar posthume ne devrait pas être possible sans une autorisation clairement formulée en amont, avec des limites précises : pendant combien de temps ? pour quels usages ? pour quels proches ? avec quelles restrictions ?

Le troisième principe est celui d’un cadre d’usage limité, ritualisé, non addictif. Pas de notifications. Pas de relances. Pas de mécanismes de captation de l’attention. Pas d’illimitation présentée comme un bien. L’outil, s’il existe, doit rester ponctuel, situé, pensé, entouré.

Le quatrième principe serait l’existence d’un bouton d’arrêt réel, d’une possibilité de clôture, voire de « funérailles numériques ». Il faut qu’un échange avec un avatar puisse être terminé dignement, sans que la personne ait le sentiment d’abandonner une présence vivante.

Le cinquième principe doit être une protection renforcée des mineurs, avec, selon toute vraisemblance, une interdiction par défaut des formes interactives les plus immersives.

Le sixième principe porte sur la sécurité des données. Pas de revente, pas d’exploitation secondaire, pas de marchandisation des traces intimes. Les données liées au deuil sont parmi les plus sensibles qui soient.

Enfin, aucun usage de l’IA dans le deuil ne devrait se substituer au soutien humain : les proches, les groupes de parole, les professionnels, les bénévoles…

Peut-il exister un usage constructif de l’IA dans le deuil ?

Après avoir nommé ces nombreux dangers, faut-il conclure qu’il faudrait rejeter en bloc l’intelligence artificielle dans le champ du deuil ? Bien sûr que non ! Non par enthousiasme technophile, mais par réalisme. Les personnes endeuillées utilisent déjà ces outils, ou les utiliseront de plus en plus. Faire comme s’ils n’existaient pas serait se condamner à l’impuissance. La vraie question n’est donc pas : « faut-il résister ou céder ? » Elle est : « comment intégrer ces outils sans trahir le processus de deuil ? »

Il existe peut-être, en effet, des usages plus justes, plus cadrés, plus symboliques, plus respectueux.

L’un d’eux pourrait être un dialogue symbolique accompagné. En thérapie, on utilise déjà des médiations comparables : écrire une lettre au défunt, parler à une chaise vide, imaginer une scène, prêter une voix à ce qu’on aurait voulu entendre. Dans ce contexte, un avatar pourrait éventuellement servir de support projectif, à condition que le cadre soit clair : il ne s’agit pas d’obtenir une vérité, mais de permettre une mise en mots. Ce qui compte n’est pas ce que « dit » l’avatar, mais ce que la personne ressent, comprend, élabore à partir de cette interaction.

L’IA pourrait aussi, dans certains cas très spécifiques, soutenir la reconstruction du sens du lien. Non pas en maintenant artificiellement une présence externe, mais en aidant la personne à mieux raconter l’histoire de sa relation, à identifier ce qu’elle veut garder vivant intérieurement, à passer d’un lien saturé par le manque à un lien intériorisé et apaisé.

Elle pourrait encore être utilisée dans un cadre ritualisé, très limité dans le temps, comme un sas psychique contenant, notamment dans certains deuils traumatiques, pour soutenir une exposition graduée à certains souvenirs, ou pour préparer une confrontation émotionnelle difficile. Mais un tel usage supposerait une compétence clinique réelle. Il ne saurait être livré à une « consommation » privée, sans accompagnement professionnel.

Dans d’autres cas, l’IA pourrait servir à externaliser certains conflits internes : colère, culpabilité, regrets, paroles impossibles. Là encore, son intérêt ne résiderait pas dans la pseudo-réponse du défunt, mais dans sa capacité à offrir un espace de projection et d’intégration.

En somme, le potentiel positif de l’IA dans le deuil n’existe que sous une condition essentielle : qu’elle reste un outil secondaire, au service d’un travail humain, psychique, symbolique et relationnel ; il ne doit jamais être un substitut à la perte, jamais un remplaçant du défunt, jamais une nouvelle norme relationnelle.

Ce qui doit rester au centre

Dans tous les cas, une chose ne doit jamais être perdue de vue : le cœur du deuil n’est pas technologique. Il est humain.

Le deuil a besoin de temps. Il a besoin de présence réelle. Il a besoin de paroles vraies, de silence parfois, de rituels, d’accompagnement, de soutien, d’un tissu relationnel suffisamment fiable pour que la personne puisse traverser la douleur sans y être engloutie. Il a besoin d’un espace où l’absence puisse être peu à peu apprivoisée – et non niée ; où le lien puisse être transformé – et non simulé ; où la mémoire puisse rester vivante, sans devenir une prison ; où la vie puisse, un jour, être réinvestie sans trahison.

C’est pourquoi il faut se méfier de toute promesse technologique qui suggérerait, même implicitement, qu’il serait possible de contourner la perte. Il n’existe pas de bouton « anti-douleur » du deuil. Il n’existe pas d’application qui dispenserait de traverser l’absence. Il n’existe pas de simulation assez sophistiquée pour remplacer la vérité d’un être aimé.

L’IA peut peut-être parfois soutenir un travail symbolique. Elle peut offrir des médiations nouvelles. Elle peut aider certains professionnels à inventer des outils plus fins. Elle peut même, dans un cadre très rigoureux, ouvrir des possibilités intéressantes. Mais dès qu’elle prétend se substituer à la relation intérieure de deuil, dès qu’elle brouille le réel, dès qu’elle encourage l’illusion de continuité, dès qu’elle exploite la vulnérabilité, elle cesse d’aider. Elle devient un insidieux obstacle.

Une responsabilité collective

Nous sommes à un moment charnière. Ce qui se joue aujourd’hui autour de l’IA dans le deuil dépasse de loin la seule question technique. Il s’agit de savoir quel type de société nous voulons devenir. Une société qui accompagne la vulnérabilité avec délicatesse, prudence et discernement ? Ou une société qui transforme toutes les dimensions de l’existence, y compris la plus intime, en opportunités de marché, de captation et de simulation ?

Il ne suffit pas de s’émerveiller devant les performances de l’intelligence artificielle. Il faut aussi apprendre à lui opposer des limites. Non par nostalgie du passé, ni par peur irrationnelle du progrès, mais parce que tout progrès n’est réellement humain que s’il demeure en phase avec la dignité des personnes.

Dans le champ du deuil, cela demande une vigilance particulière. Les personnes endeuillées ne sont pas des « utilisateurs » comme les autres. Elles traversent un état de fragilité, parfois de désorganisation, parfois d’extrême solitude. Elles méritent mieux qu’une technologie fascinante livrée sans cadre. Elles ont besoin d’un environnement éthique, protecteur, contenant, où l’innovation ne se fait pas au prix de leur intégrité psychique.

Il est donc urgent que des cliniciens, des philosophes, des juristes, des éthiciens, des associations de deuil, des familles concernées, des concepteurs technologiques et des décideurs publics se saisissent ensemble de cette question. Il faut penser maintenant les cadres, les interdits, les usages acceptables, les lignes rouges, les dispositifs de protection. Car si nous ne le faisons pas, d’autres le feront à notre place – et probablement selon des logiques qui n’auront pas pour priorité le soin de l’humain.

Aider l’humain, non l’assujettir

L’intelligence artificielle entre dans nos vies. Elle entre aussi, désormais, dans nos morts. Nous avons besoin, sur ce sujet, d’une position à la fois lucide et nuancée. Refuser l’IA tout en bloc serait aveugle. Accepter tout sans cadre serait également irresponsable. Entre ces deux extrêmes, il existe une voie plus exigeante : penser, nommer, baliser, protéger et accompagner.

L’IA doit rester à sa juste place : un outil possible, secondaire, encadré, jamais une réponse totale. Elle peut aider l’humain. Elle ne doit jamais l’assujettir.